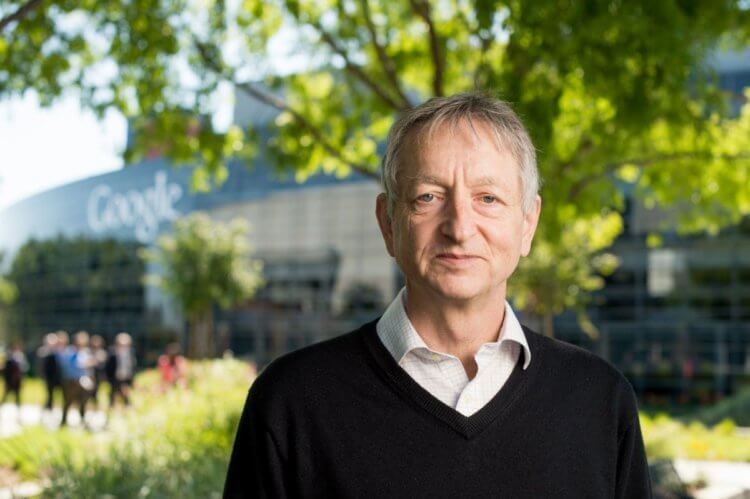

Jeffrey Hinton - a koncepció egyik alkotójamélyreható tanulás, a Turing Award 2019 díjazottja és a Google mérnök. A múlt héten egy I / O fejlesztői konferencia során Wired megkérdezte őt, és megvitatta az agyát és az agyi struktúrán alapuló számítógép modellezésének képességét. Hosszú ideig ezeket az elképzeléseket ostobának tekintették. Érdekes és lenyűgöző beszélgetés a tudatról, Hinton jövőbeli terveiről és arról, hogy a számítógépeket álmodni lehet-e.

Mi lesz a neurális hálózatokkal?

Kezdjük azokkal az időkkel, amikor írtálelső, nagyon befolyásos cikkeiket. Mindenki azt mondta: "Az ötlet okos, de valójában nem tudunk ilyen módon tervezni számítógépeket." Magyarázd el, miért ragaszkodtál magadhoz, és miért voltál olyan biztos, hogy valami fontosat találtál.

Úgy tűnt, hogy az agy nem tud valahogy működnimásként nem rendelkezik. Ő köteles dolgozni, tanulmányozza a kapcsolatok erejét. És ha azt szeretné, hogy az eszköz valami okos legyen, két lehetősége van: programozhatja vagy tanul. És senki sem programozott embereket, így meg kellett tanulnunk. Így kellett volna.

Magyarázza el, hogy milyen neurális hálózatok vannak. Magyarázza el az eredeti bemutatót.

Viszonylag egyszerű megmunkálás.elemek, amelyek nagyon távolról emlékeztetnek a neuronokra. Bejövő kapcsolataik vannak, minden kapcsolatnak súlya van, és ez a súly a képzési folyamat során változhat. Amit egy neuron csinál, lépéseket tesz a kapcsolatokkal a súlyokkal szorozva, összegzi őket, majd eldönti, hogy adatot küld-e. Ha az összeg elég nagy, akkor egy kimenetet eredményez. Ha az összeg negatív, nem küld semmit. Ez minden. Csak akkor kell összekötni egy ilyen neuronok felhőjét, és kitalálni, hogyan változtathatja meg ezeket a súlyokat, majd meg fogják csinálni, amit akarnak. Az egyetlen kérdés az, hogy hogyan változtatja meg a súlyt.

Mikor rájöttél, hogy ez egy durva ötlet arról, hogyan működik az agy?

Ó, igen, mindent eredetileg szántak. Úgy tervezték, hogy hasonlítson az agyra a munkában.

Tehát, egy bizonyos pontján a karrieredbenelkezdte megérteni, hogyan működik az agy. Talán tizenkettő volt, talán huszonöt. Mikor döntöttél úgy, hogy próbálkozzon számítógépek modellezésével?

Igen, azonnal. Ez volt az egész pont. Az egész ötlet az volt, hogy hozzon létre egy olyan tanulási eszközt, amely megtanulja az agyat, az emberek ötleteinek megfelelően, hogy miként tanul az agy, a kapcsolatok erősségének megváltoztatásával. És nem az én ötletem volt, Turingnek ugyanaz az ötlete volt. Bár Turing a szabványos informatika alapjainak nagy részét feltalálta, úgy vélte, hogy az agy egy szervetlen eszköz, véletlenszerű súlyokkal, és megerősítési tréninget használt a kapcsolatok megváltoztatására, így bármit is tanulhatott. És azt hitte, hogy ez a legjobb út az intelligenciához.

És követte a Turing ötletét, hogy a legjobb módja egy autó létrehozásának - úgy tervezzük, mint egy emberi agy. Tehát azt mondják, az emberi agy működik, ezért hozzunk létre egy hasonló gépet.

Igen, nemcsak Turing gondolta. Sokan úgy gondolták.

Mikor jöttek a sötét idők? Amikor megtörtént, hogy más dolgozók, akik dolgoztak rajta, és azt hitték, hogy Turing ötlete igaza volt, elkezdtek visszavonulni, és továbbra is hajlítottad a sort?

Mindig is maroknyi ember hittmindentől függetlenül, különösen a pszichológia területén. De a számítógép-tudósok között, úgy gondolom, a 90-es években kiderült, hogy az adatkészletek elég kicsiek voltak, és a számítógépek nem voltak olyan gyorsak. A kis adatállományok esetében más módszerek, különösen a támogató vektor gép, egy kicsit jobban működött. Nem voltak olyan zavarba a zajok. Szóval ez mind szomorú volt, mert a 80-as években kifejlesztettünk egy hátsó terjedési módszert [hátsó terjedés, a neurális hálózatok számára nagyon fontos hiba terjedési módszer]. Azt hittük, mindent megold. És meglepődtek, hogy nem döntött semmit. A kérdés valóban nagyságrendű volt, de nem tudtuk.

Miért gondoltad, hogy nem működik?

Azt hittük, nem működik, mert voltnem volt elég helyes algoritmus és nem igazán helyes célfüggvény. Hosszú ideig arra gondoltam, hogy ez azért van, mert a megfigyelés alatt próbáltunk képzést folytatni, amikor az adatokat címkézettük, és megfigyelés nélkül kellett képzést folytatnunk, amikor a képzés nem megjelölt adatok szerint történik. Kiderült, hogy a kérdés nagyrészt a skála volt.

Ez érdekes. Kiderült, hogy a probléma az volt, hogy nem volt elegendő adat. Azt hitte, hogy a megfelelő mennyiségű adat van, de helytelenül jelölte meg. Kiderült, hogy csak helytelenül azonosította a problémát?

Azt hittem, a hiba az volt, hogy mi voltunkcímkék használata. A tanulás nagy része semmilyen címke használata nélkül történik, csak az adatok struktúráját modellezi. Valójában még mindig úgy gondolom. Úgy gondolom, hogy mivel a számítógépek gyorsabbá válnak, ha a számítógép elég gyors, jobb, ha megfigyelés nélkül végeznek képzést bármilyen adott adathalmazra. És amint befejezte a tanulmányt megfigyelés nélkül, kisebb számokkal tudsz tanulni.

Tehát az 1990-es években folytatja a kutatást,Ön tudományos körökben van, még mindig közzéteszi, de nem oldja meg a nagy problémákat. Volt már egy pillanat, amikor azt mondtad: „Tudod, ez elég. Próbálok valami mást csinálni? Vagy egyszerűen azt mondtad magadnak, hogy továbbra is mélyreható tanulást fogsz folytatni [azaz a koncepciót mély tanulás, mély tanulási neurális hálózatok; olvass tovább itt.]

Igen. Ilyennek kell lennie. Úgy értem, az agyban lévő vegyületek valamilyen módon tanulnak, pontosan meg kell kitalálni, hogyan. És talán sok különböző módon lehet erősíteni a tanulási folyamat kapcsolatait; az agy az egyiket használja. Lehet más módon is. De szükséged van valamire, ami erősítheti ezeket a vegyületeket a képzés során. Soha nem kételkedett.

Soha nem kételkedtél. Mikor érzem, hogy működik?

A 80-as évek egyik legnagyobb csalódása volthogy ha sok rejtett rétegű hálózatot hoztunk létre, nem tudtuk kiképezni őket. Ez nem teljesen igaz, mert viszonylag egyszerű folyamatokat, mint a kézírás. De nem tudtuk, hogyan kell a mély neurális hálózatok nagy részét képezni. És valahol 2005-ben jöttem létre a mély hálózatok megfigyelés nélküli kiképzésére. Adatokat, például pixeleket ad meg, és több részlet detektort képez, amelyek egyszerűen elmagyarázzák, hogy miért voltak a képpontok. Ezután az adatokat a részérzékelőkhöz adjuk, és egy másik detektorkészletet készítünk, hogy megmagyarázhassuk, miért vannak specifikus részérzékelők specifikus korrelációi. Folytatod a rétegek rétegképzését. De a legérdekesebb dolog az volt, hogy matematikailag felbomlott és bebizonyíthatod, hogy minden alkalommal, amikor egy új réteget tanítasz, nem feltétlenül javítod az adatmodellt, de meg kell oldanod, hogy milyen jó a modelled. És ez a tartomány minden egyes réteghez jobb lett.

Mit jelent az, hogy a modell milyen jó?

Miután megkaptad a modellt, megkérdezhetedkérdés: "Milyen szokatlan ez a modell az adatok megtalálásában?" Bemutatod neki az adatokat, és kérdezed: "Megtalálod mindezt, amilyennek szánta, vagy szokatlan?" És ez mérhető. És egy olyan modellt akartam kapni, amely egy jó modell, amely az adatokat vizsgálja, és azt mondja: „Igen, igen. Ezt tudtam. Ez nem meglepő. Mindig nagyon nehéz pontosan kiszámítani, hogy a modell milyen szokatlanul veszi figyelembe az adatokat. De kiszámíthatja ennek tartományát. Elmondható, hogy a modell ezt az adatot kevésbé szokatlannak találja. Megállapítható, hogy az új rétegek hozzáadásával a részletes detektorokhoz egy modell képződik, és minden hozzáadott réteg esetében, amikor az adatokat megtalálja, az adatok megismerésének szokatlanul jobb tartománya.

Kiderült, hogy körülbelül 2005-ben végzettez a matematikai áttörés. Mikor kezdted meg a helyes válaszokat? Milyen adatokat dolgozott? Megvan az első áttörés a beszédadatokkal, ugye?

Ezek csak kézzel írt számok voltak. Nagyon egyszerű. Ezzel egy időben a GPU (grafikus processzorok) fejlesztése megkezdődött. A neurális hálózatokban résztvevő emberek 2007-ben kezdték el használni a GPU-t. Nagyon jó diákom volt, aki elkezdte a GPU-k használatát a légi felvételek útvonalait keresni. Ő írta a kódot, amelyet aztán más diákok fogadtak el, akik a GPU-t használják felismerni a beszéd fonémáit. Ezt a korábbi tanulás ötletét használták. És amikor az előképzés befejeződött, csak a címkéket helyezték a tetejére, és használták a fordított terjedést. Kiderült, hogy létrehozhat egy nagyon mély hálózatot, amelyet korábban ilyen módon képzettek. Ezután a hátsó terjedést lehetett alkalmazni, és ténylegesen működött. A beszédfelismerésben ez tökéletesen működött. Először azonban nem volt sokkal jobb.

Jobb volt, mint a kereskedelmi forgalomban kapható beszédfelismerés? Megkerülte a beszédfelismerés legjobb tudományos munkáját?

Egy viszonylag kis TIMIT nevű adatkészletben kissé jobb volt, mint a legjobb tudományos munka. Az IBM is sok munkát végzett.

Nagyon gyorsan, az emberek rájöttek, hogy mindez - már ettőlelkerüli a 30 évig kifejlesztett szabványos modelleket - jól fog működni, ha egy kicsit fejlődik. A diplomások a Microsoftba, az IBM-be és a Google-ba kerültek, és a Google nagyon gyorsan létrehozott egy működő beszédfelismerőt. 2012-re ez a munka, amely 2009-ben történt, az Androidra került. Android hirtelen sokkal jobban felismerte a beszédet.

Mondd el nekem, hogy mikor, aki 20 éven át ezen az ötleten tartotta ezeket az ötleteket, hirtelen megkerülte kollégáit. Mit néz ez az érzés?

Nos, akkoriban csak 30 évig tartottam ezeket az ötleteket!

Jobb, igaz!

Csodálatos érzés volt, hogy mindez végül valódi problémává vált.

Emlékszel, amikor először kaptad meg ezt az adatokat?

Nem.

Rendben. Szóval, megérti, hogy a beszédfelismeréssel működik. Mikor kezdtétek a neurális hálózatok alkalmazását más problémákra?

Először kezdtük őket alkalmazni mindenféleegyéb problémák. George Dahl, akivel kezdetben a beszédfelismerésen dolgoztunk, arra használta őket, hogy megjósolják, hogy egy molekula képes-e valamivel kapcsolatba lépni és jó gyógyszerré válna. És volt egy verseny. Egyszerűen alkalmazta a szabványos beszédfelismerő technológiát a drogaktivitás előrejelzésére és megnyerte a versenyt. Jele volt, hogy valami nagyon univerzális dolgot csinálunk. Aztán megjelent egy diák, aki azt mondta: „Tudod, Jeff, ez a dolog a képfelismeréssel fog működni, és Fey-Fey Lee létrehozott egy megfelelő adatot erre. Van egy nyilvános verseny, tegyünk valamit.

Olyan eredményeket kaptunk, amelyek sokkal jobbak voltak a standard számítógépes látásnál. 2012 volt.

Ez azt jelenti, hogy e három területen sikerült: a vegyi anyagok modellezése, beszéd, hang. Hová tévedtél?

Megértette, hogy a hibák ideiglenesek?

Nos, mi határozza meg azt a területet, ahol minden működik?leggyorsabban, és ahol több időre van szükség? Úgy tűnik, hogy a vizuális feldolgozás, a beszédfelismerés és az olyan alapvető emberi dolgok, amelyeket érzékszervi érzékeléssel csinálunk, az első akadályok, amelyeket meg kell küzdeni, igaz?

És igen és nem, mert vannak más dolgok isugyanaz a motilitás, amit jól csinálunk. Nagyon jó vagyunk a motoros készségek szabályozásában. Agyunkat mindenképpen ehhez igazítjuk. És most csak a neurális hálózatok versenyeznek a legjobb egyéb technológiákkal. A végén nyerni fognak, de most kezdik megnyerni.

Azt hiszem, gondolkodás, absztrakt gondolkodás - az utolsó dolgok, amiket megtanulunk. Azt hiszem, azok az utolsó dolgok közé tartoznak, amelyeket ezek a neurális hálózatok megtanulnak.

És így azt mondod, hogy a neurális hálózatok végül mindenhol nyernek.

Nos, neurális hálózatok vagyunk. Minden, amit tudunk, ők is.

Igaz, de az emberi agy messze van a valaha létrehozott leghatékonyabb számítógéptől.

Határozottan nem.

Határozottan nem az emberi agyam! Van-e mód arra, hogy olyan gépeket modellezzünk, amelyek sokkal hatékonyabbak, mint az emberi agy?

A filozófia szempontjából nincs kifogásomellentétben azzal az elképzeléssel, hogy teljesen más módon lehetne mindent megtenni. Talán, ha logikával kezdesz, próbáld meg automatizálni a logikát, jöjjön létre néhány bizarr bizonyíték a tételekre, vitatkozz, majd döntsd el, hogy az érvelés során vizuális érzékelésre jutsz, lehet, hogy ez a megközelítés nyer. De még nem. Nincs filozófiai kifogásom egy ilyen győzelemre. Csak tudjuk, hogy az agy képes rá.

De van olyan dolog, amit az agyunk nem képes jól csinálni. Ez azt jelenti, hogy a neurális hálózatok nem is képesek jól teljesíteni őket?

Lehetséges, igen.

És van egy külön probléma, ami azt jelenti, hogy nem teljesen értjük, hogyan működnek a neurális hálózatok, ugye?

Igen, tényleg nem értjük, hogyan működnek.

Nem értjük, hogyan működnek együtt a neurális hálózatoklefelé irányuló megközelítés. Ez a neurális hálózatok munkájának fő eleme, amelyet nem értünk. Magyarázd el ezt, majd engedjék meg, hogy a következő kérdést tegyem fel: ha tudjuk, hogyan működik minden, akkor hogyan működik ez?

Ha megnézed a modern rendszereketszámítógépes látás, legtöbbjük elsősorban előre irányul; nem használnak visszacsatolási kapcsolatokat. Van még egy dolog a modern számítógépes látásrendszerekben, amelyek nagyon érzékenyek a versenyhibákra. Kicsit megváltoztathatsz néhány pixelt, és mi volt a panda kép, és még mindig pontosan úgy néz ki, mint egy panda, mert hirtelen strucc lesz a neurális hálózat megértésében. Nyilvánvaló, hogy a képpontok cseréjének módja úgy van megtervezve, hogy megtévessze a neurális hálózatot, arra kényszerítve, hogy gondoljon a struccra. De az a tény, hogy Ön számára még mindig panda.

Kezdetben úgy gondoltuk, hogy minden működött.tökéletesen. De aztán, azzal a szemmel, hogy egy pandára néznek, és bízik abban, hogy ez egy strucc, aggódunk. És úgy gondolom, hogy a probléma egy része az, hogy nem próbálnak rekonstruálni a magas szintű képviseletekből. Elkülönítve próbálnak tanulni, ha csak a detektor detektálásának rétegeit képezik, és az egész célja a súlyok megváltoztatása, hogy jobban kereshessék a helyes választ. Nemrég felfedeztük Torontóban, vagy Nick Frost felfedezte, hogy ha újjáépítést adsz, az ellenállás az ellenséges hibával növekszik. Úgy gondolom, hogy az emberi elképzelésben a rekonstrukciót használják. És mivel sokat tanulunk egy újjáépítéssel, sokkal ellenállóbbak vagyunk a versenytámadásokkal szemben.

Úgy gondolod, hogy a neurális hálózatban a lefelé irányuló kommunikáció lehetővé teszi, hogy ellenőrizze, hogyan rekonstruálnak valamit. Ellenőrizze, és győződjön meg róla, hogy ez egy panda, nem egy strucc.

Azt hiszem, ez fontos, igen.

De a tudósok, akik tanulmányozzák az agyat, nem teljesen egyetértenek?

Az agykutatók nem érvelnek azzal, hogy ha van kettena kéreg területét az észlelés útján, mindig fordított kapcsolatok lesznek. Azzal érvelnek, hogy mi az. Szükség lehet a figyelemre, a képzésre vagy az újjáépítésre. Vagy mindhárom.

És ezért nem tudjuk, mi a visszajelzés. Új neurális hálózatait építed, azzal a feltevéssel, hogy ... nem, még nem is - visszacsatolást készítsz, mert a neurális hálózatok rekonstrukciójához szükséges, bár nem is érted, hogyan működik az agy?

Igen.

Ez nem trükk? Nos, ez az, ha próbál valamit csinálni, mint egy agy, de nem biztos benne, hogy mit csinál az agy?

Nem igazán. Nem csinálok számítási idegtudományt. Nem próbálok létrehozni az agy modelljét. Megnézem az agyat, és azt mondom: "Működik, és ha valami mást akarunk csinálni, akkor meg kell nézni és inspirálnia kell." A neuronok inspiráltak, nem pedig neurális modellt építenek. Így az egész modell, az általunk használt neuronok az, hogy a neuronok sok kapcsolattal rendelkeznek, és megváltoztatják a súlyokat.

Ez érdekes. Ha számítógépes tudós vagyok, és neurális hálózatokon dolgoztam, és meg akartam kerülni Jeff Hintont, az egyik lehetőség egy downlink kommunikáció kiépítése, és az agyi tudományok más modelljeire épül. A képzésen, nem pedig az újjáépítésen alapul.

Ha jobb modellek lennének, nyertél volna. Igen.

Nagyon, nagyon érdekes. Érintsünk egy általánosabb témát. Tehát a neurális hálózatok megoldhatják az összes lehetséges problémát. Vannak-e az emberi agy rejtvényei, amelyek nem vagy nem fedik le a neurális hálózatokat? Például érzelmek.

Nem.

Tehát a szeretetet egy neurális hálózat rekonstruálhatja? A tudatosság rekonstruálható?

Abszolút. Ha rájön, mit jelentenek ezek a dolgok. Neurális hálózatok vagyunk, ugye? A tudat különösen érdekes téma számomra. De ... az emberek nem igazán tudják, mit jelentenek ez a szó. Sok különböző definíció létezik. És azt hiszem, ez egy meglehetősen tudományos kifejezés. Ezért ha 100 évvel ezelőtt kérdezted az embereket: mi az élet? Válaszolnának: „Nos, az élőlényeknek életereje van, és amikor meghalnak, az életerő elhagyja őket. Ez a különbség az élők és a halottak között, akár életerővel, akár nem. Most nincs vitalitásunk, úgy gondoljuk, hogy ez a koncepció a tudomány előtt jelent meg. És amint elkezdesz egy kis megértést a biokémia és a molekuláris biológia területén, már nincs szükséged a vitalitásra, meg fogod érteni, hogy ez tényleg működik. És ugyanezt, azt hiszem, a tudatossággal fog történni. Úgy gondolom, hogy a tudatosság egy kísérlet arra, hogy elmagyarázza a mentális jelenségeket egy entitás használatával. És ez az egység nem szükséges. Amint megmagyarázhatod, megmagyarázhatod, hogy mindent megteszünk, ami az embereket tudatos lényekké teszi, megmagyarázza a tudat különböző jelentését, anélkül, hogy konkrét entitásokat vonzana.

Kiderül, hogy nincs érzelem, ami nemhozna létre? Nem gondoltam létrehozni? Nincs semmi, amit az emberi elme tehet, hogy elméletileg lehetetlen lenne egy teljesen működőképes neurális hálózatot újra létrehozni, miután megértjük, hogyan működik az agy?

John Lennon valami hasonlót énekelt az egyik daljában.

100% -ban biztos benne?

Nem, én vagyok a Bayes-i vagyok, így 99,9% -ban biztos vagyok benne.

Nos, mi ez a 0,01%?

Nos, mindannyian egy nagy szimuláció részét képezhetnénk.

Fair. Szóval, mit tanulunk az agyról a számítógépünkön végzett munkánk során?

Nos, azt hiszem, amit megtanultunkaz elmúlt 10 évben érdekes, hogy ha egy olyan rendszert használunk, amely több milliárd paraméterrel és célfunkcióval rendelkezik - például egy szavak sorában lévő rés kitöltésével - jobban fog működni, mint amennyire kellene. Sokkal jobban fog működni, mint amire számíthat. Gondolhatnánk, és sok ember a hagyományos kutatási kutatás területén azt gondolja, hogy egy milliárd paraméterrel rendelkező rendszert vehet fel, véletlenszerűen futtathatja, mérheti a célfüggvény gradiensét, majd kijavíthatja az objektív funkció javítása érdekében. Gondolhatod, hogy egy reménytelen algoritmus elkerülhetetlenül elakad. De nem, kiderül, ez egy nagyon jó algoritmus. Minél nagyobb a skála, annál jobban működik. És ez a felfedezés lényegében empirikus volt. Mindezek mögött természetesen volt néhány elmélet, de a felfedezés empirikus volt. És most, mivel ezt felfedeztük, valószínűbbnek tűnik, hogy az agy kiszámítja egy bizonyos objektív függvény gradiensét, és frissíti a szinapszisok kapcsolatának súlyát és erejét, hogy lépést tartson ezzel a gradienssel. Csak meg kell találnunk, hogy ez a célfüggvény és hogyan romlik.

De nem értettük az agy példáján? Nem értette a frissítési súlyokat?

Ez egy elmélet volt. Régen az emberek azt hitték, hogy lehetséges. A háttérben azonban mindig voltak olyan számítógép-tudósok, akik azt mondták: „Igen, de az a gondolat, hogy a gradiens leszármazása miatt minden véletlen és tanulás nem fog működni milliárd paraméterrel, sok tudást kell csatlakoztatnia”. Most már tudjuk, hogy nem. Egyszerűen megadhatja a véletlenszerű paramétereket, és mindent megtudhat.

Vegyünk egy kicsit. Ahogy egyre többet megtanulunk, elvárjuk, hogy egyre többet tanuljunk arról, hogyan működik az emberi agy, mivel az agyfunkciókkal kapcsolatos elképzeléseinken alapuló tömeges teszteket fogunk végezni. Amint ezt jobban megértjük, lesz egy pillanat, amikor lényegében újjáépítjük agyunkat, hogy sokkal hatékonyabb gépekké váljunk?

Ha valóban megértjük, mi történik, mijavíthatunk néhány dolgot, mint például az oktatás. És azt hiszem, javulni fogunk. Nagyon furcsa lenne végül megérteni, mi történik az agyadban, hogyan tanul, és nem alkalmazkodik oly módon, hogy jobban tanuljon.

Mit gondolsz, hogyan használjuk pár év múlva azt, amit az agyról és a mély tanulásról tanultunk, az oktatás megváltoztatására? Hogyan változtatnád az osztályokat?

Nem vagyok biztos benne, hogy pár év múlva sokat tanulunk. Úgy gondolom, hogy az oktatás megváltoztatása hosszabb időt vesz igénybe. De ha erről beszélsz, a [digitális] segítők elég okosak. És amikor a segítők megértik a beszélgetéseket, beszélhetnek a gyerekekkel és taníthatják őket.

És elméletileg, ha jobban megértjük az agyat, akkor a segédeket programozni tudjuk, hogy jobban beszélhessenek a gyerekekkel, kezdve a már megtanultaktól.

Igen, de nem sokat gondolkodtam róla. Egy másikat csinálok. De mindez nagyon hasonlít az igazsághoz.

Megérthetjük, hogyan működnek az álmok?

Igen, nagyon érdekel az álmok. Annyira érdekel, hogy legalább négy különböző álomelméletem van.

Mondd el róluk - az első, második, harmadik, negyedik.

Régen olyan dolgok voltak, mint a hálózatHopfield, és emlékeket tanulmányoztak, mint helyi vonzerőt. Hopfield felfedezte, hogy ha túl sok emléket próbálsz tenni, zavarodni fognak. Két helyi vonzerőt vesznek majd, és egy vonzóként egyesítik őket valahol félúton.

Aztán jött Francis Creek és Graham Mitchison ésazt mondták, hogy megszabadulhatunk ezekről a hamis mélypontokról a tanulás nélkül (vagyis elfelejtve azt, amit megtanultunk). Letiltjuk az adatbevitelt, áthelyezzük a neurális hálózatot egy véletlenszerű állapotba, hagyjuk, hogy megnyugodjon, mondjuk, hogy rossz, változtassa meg a kapcsolatokat, hogy ne essen bele az állapotba, és így több memóriát tárolhat.

Ezután Terry Sejnovszkival jöttünk és azt mondta: - Figyelj, ha nem csak olyan idegsejtek vannak, amelyek memóriát tárolnak, hanem egy csomó más idegsejtet is, találhatunk egy olyan algoritmust, amely mindezeket a neuronokat használja az emlékek helyreállításához? Ennek eredményeként létrehoztuk a Boltzmann gépi tanulási algoritmust. És a Boltzmann gépi tanulási algoritmusának rendkívül érdekes tulajdonsága volt: megmutatom az adatokat, és egyfajta áthalad a többi egységen, amíg nagyon boldog állapotba nem kerül, és ezután növeli az összes kapcsolat erősségét, mivel két egység egyidejűleg aktív.

Önnek is van egy fázisa, amelyben Önkapcsolja ki a bemenetet, hagyja, hogy az algoritmus „megforduljon”, és azt egy olyan állapotba fordítsa, amelyben elégedett, hogy fantáziáljon, és amint fantáziája van, azt mondja: „Vegye ki az aktív neuronok párját, és csökkenti a kapcsolatok erejét.”

Elmagyarázom az algoritmust, mint eljárást. A valóságban ez az algoritmus a matematika terméke, és a kérdés: „Hogyan kell megváltoztatni ezeket a kapcsolati láncokat, hogy ez a neuralis hálózat az összes rejtett egységgel ne találjon semmilyen adatot?”. És egy másik fázisnak kell lennie, amelyet negatív fázisnak nevezünk, amikor a hálózat adatbevitel nélkül működik, és megtanulja, függetlenül attól, hogy milyen állapotban van.

Éjszaka sok órán át álmokat látunk. És ha hirtelen felébredsz, azt mondhatod, hogy csak álmodtál, mert az álom rövid távú memóriában van tárolva. Tudjuk, hogy sok órán át álmokat látunk, de reggel, ébredés után csak az utolsó álmot emlékezhetjük meg, mások nem emlékeznek arra, hogy nagyon sikeres volt, mert tévedés lenne, ha valóságnak tekintjük őket. Akkor miért nem emlékszünk egyáltalán álmainkra? Crick szerint ez az álmok jelentése: ezek megtanulása. Megtanulod az ellenkezőjét.

Terry Seinowski és én megmutattuk, hogy ez valójában egy olyan tanulási eljárás, amelynek a legnagyobb valószínűsége a Boltzmann gépek számára. Ez az első álomelmélet.

Át akarok váltani a többi elméletre. De kérdezd meg a kérdést: sikerült kiképezni a mély tanulási algoritmusokat, hogy valóban álmodj?

Az első algoritmusok egyikeA rejtett egységekkel való munka megismerése érdekében Boltzmann gépek voltak. Rendkívül hatástalanok voltak. De később megtaláltam a módját, hogy közelíthessünk, ami eredményesnek bizonyult. És ez valóban megindította a munkát a mély tanulással. Ezek olyan dolgok, amelyek egyszerre tanították a funkció detektorok egy rétegét. És ez volt a Boltzmann korlátozó gép hatékony formája. És így foglalkozott ezzel a fordított képzéssel. De ahelyett, hogy aludna volna, csak egy kicsit fantáziálhatott minden egyes címke után az adatokkal.

Nos, ez azt jelenti, hogy az androidok valóban álmodnak az elektroshotokról. Folytassuk a két, három és négy elméletet.

A Theory Two elnevezése Wake Sleep algoritmus volt[ébresztő-alvási algoritmus]. Önnek generatív modellt kell képeznie. És van egy ötleted, hogy hozzon létre egy olyan adatbázist, amely képes adatokat generálni, tulajdonságérzékelő rétegei és aktiválja a magasabb és alsó rétegeket, és így tovább, a képpontok aktiválásáig - a kép létrehozása. De szeretnéd tanítani neki egy másik. Szeretné, ha felismeri az adatokat.

És így két algoritmust kell csinálnodfázisban. Az ébresztési fázisban az adatok beérkeznek, megpróbálja felismerni őket, és ahelyett, hogy megismerné a felismeréshez használt kapcsolatokat, tanulmányozza a generatív kapcsolatokat. Az adatok megérkeznek, aktiválom a rejtett egységeket. Aztán megpróbálom megtanítani ezeket a rejtett egységeket az adatok helyreállítására. Megtanulja, hogy minden rétegben rekonstruáljon. De a kérdés az, hogy hogyan kell a közvetlen kapcsolatokat tanulmányozni? Ezért az az elképzelés, hogy ha közvetlen kapcsolatokat ismer, megtanulhat fordított kapcsolatokat, mert megtanulhatod, hogyan kell rekonstruálni.

Most kiderül, hogy ha használodfordított kapcsolatok, megtanulhat és közvetlen kapcsolatokat hozhat létre, mert csak elkezdhetsz a tetejéről és generálhatsz egy kis adatot. És mivel adatokat generál, ismeri az összes rejtett réteg állapotát, és tanulmányozhatja a közvetlen kapcsolatokat az állapotok helyreállításához. És ez az, ami történik: ha véletlenszerű kapcsolatokkal kezdjük, és megpróbálod felváltva használni mindkét fázist, minden kiderül. Ahhoz, hogy jól működjön, különböző lehetőségeket kell próbálnia, de működni fog.

Nos, mi van a másik két elmélettel? Már csak nyolc perc van hátra, azt hiszem, nem lesz időm mindent kérdezni.

Adj még egy órát, és elmondom a másik kettőről.

Beszéljünk arról, hogy mi következik. Hol mennek a tanulmányai? Milyen problémákat próbál most megoldani?

Végül valamit dolgoznunk kellmilyen munka még nem fejeződött be. Azt hiszem, dolgozhatok olyan dolgokkal, amelyeket soha nem fogok befejezni, úgynevezett „kapszulák”, elmélet arról, hogyan történik a vizuális észlelés újjáépítése és az információk megfelelő helyre történő elküldése. A két fő motiváló tényező az volt, hogy a normál neurális hálózatokban az információ, a réteg aktivitása automatikusan csak valahol megy, és nem dönt arról, hogy hol küldje el. A kapszulák ötlete az volt, hogy döntéseket hozzon arról, hogy hol küldje el az információt.

Most, amikor elkezdtem dolgozni a kapszulákon, nagyon okos emberek vették fel a Google-t a hasonló transzformátorokat. Úgy döntenek, hogy hol kell elküldeni az információt, és ez egy nagy győzelem.

A következő évben visszatérünk a harmadik és a negyedik álmok elméleteiről.

Regisztráljon a Telegramban lévő csevegésben, hogy ne maradjon ki.

A cikk Maria Menshikova illusztrációit használja.